Pocas historias de crecimiento han sido tan emblemáticas y estudiadas como la de Facebook. Desde sus humildes comienzos en un dormitorio

universitario, Facebook se ha convertido en una de las...

La idea de que "no tengo ideas" no debería ser una excusa para la falta de contenido en redes sociales. Exploraremos cómo puedes utilizar diversas

plataformas de redes sociales para...

LinkedIn, la red social profesional por excelencia, ofrece un vasto mundo de oportunidades para aquellos que buscan expandir su red, encontrar

nuevas oportunidades laborales y establecer su marca personal en...

En la encrucijada de la conectividad digital, las redes sociales se han convertido en el epicentro de nuestras interacciones en línea, dando forma

no solo a la forma en que...

En la era digital actual, las redes sociales no solo son lugares para conectarse con amigos y familiares, sino también poderosas plataformas de

marketing y ventas. El término "Social Commerce"...

En el vertiginoso mundo de las redes sociales y la información instantánea, crear contenido viral se ha convertido en una meta codiciada.

Comprender tu Eje Central: En el núcleo de...

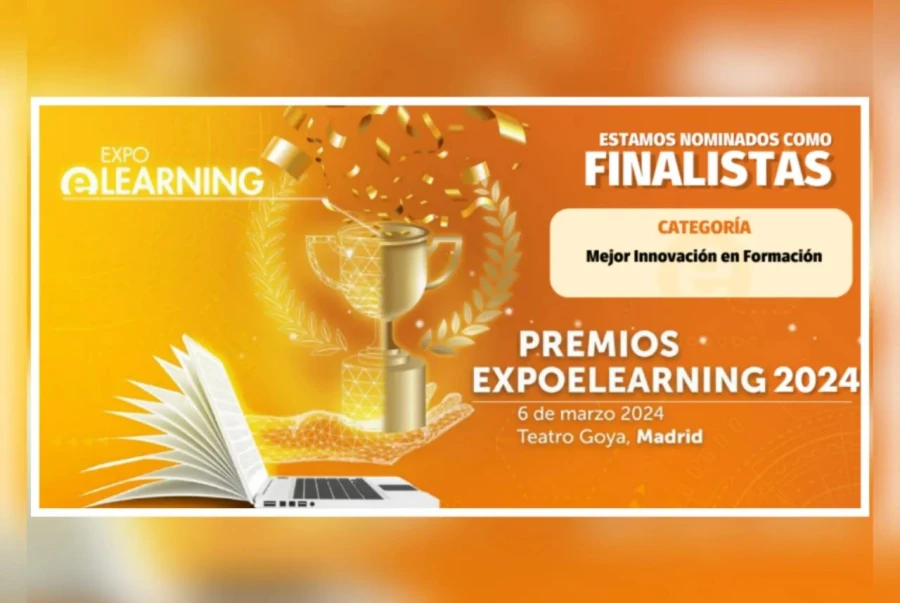

Dos proyectos de la institución educativa (un Escape Room y el uso de Telegram) llegan a la fase final de los reconocidos premios anuales del

ámbito e-learning

Las redes sociales han transformado la forma en que interactuamos, nos comunicamos y compartimos información. Sin embargo, a medida que estas

plataformas han crecido en influencia y alcance, el debate...

En los últimos años, las redes sociales han dejado de ser simplemente plataformas de conexión y entretenimiento para convertirse en poderosas

herramientas de ventas. El comercio electrónico social, o "social...